핵심 요약

AWS가 Strands Agents SDK와 TwelveLabs 모델을 활용해, 사용자의 자연어 요청에 따라 영상 임베딩·검색·요약·자막 추출 등을 조합하는 에이전틱 비디오 엔진 구현 사례를 소개합니다.

구현 방법

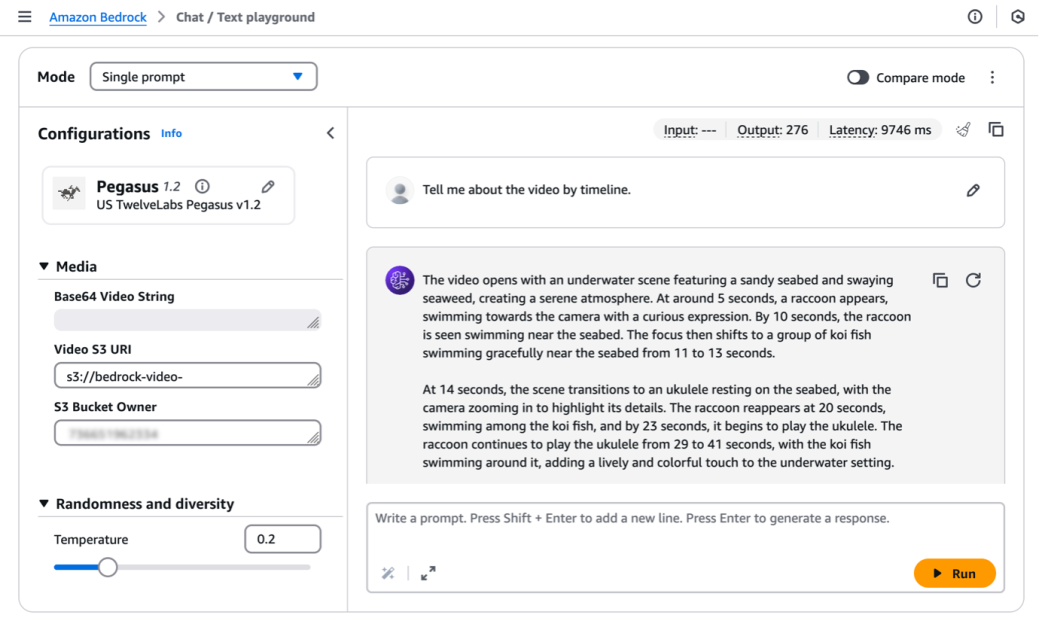

- 환경 설정: Bedrock Claude Sonnet 연결, TwelveLabs Marengo-embed/pegasus, S3 벡터DB/DynamoDB/Transcribe 구성

- 도구 구성: create_video_embedding, search_video_clips, summarize_video, get_transcript, get_keywords, get_clip_playback_url

- 에이전트 설계: 시스템 프롬프트로 도구 규칙 정의, 에이전트 루프와 훅으로 자동화 제어

주요 결과

- 다양한 도구 조합으로 상황별 영상 분석 워크플로를 구현할 수 있습니다