핵심 요약

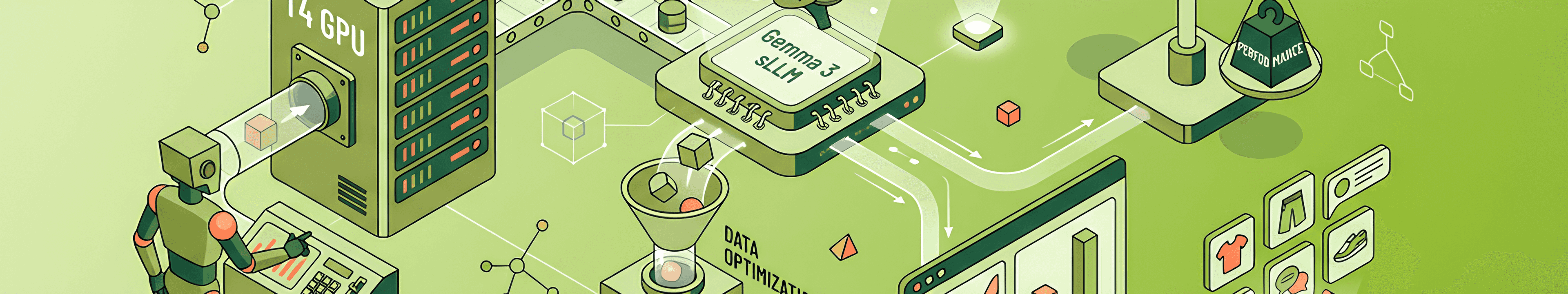

AWS가 Neosapience의 경량 LLM 추론 배치 워크로드를 GPU 인스턴스(G5/G6e/G7e)와 INT8/INT4/FP8 정밀도에서 벤치마크하고, 운영 환경의 프라이빗 연결과 리전 제약을 고려해 g6e + INT8 조합이 균형점을 제시했다는 내용을 다룹니다.

구현 방법

- TensorRT-LLM 엔진으로 경량 LLM 서빙

- AWS PrivateLink 기반 프라이빗 연결 구성

- GPT-2 XL(1.5B) 프록시 모델로 BS 1-64 벤치마크 수행

주요 결과

- g7e 벤치마크가 최고 Throughput이었으나 운영상 리전 제약 및 네트워크 영향으로 g6e INT8을 최적 선택

- g5 INT8 대비 Throughput +약 46%, TTFT -약 39%, P95 안정성 약 25% 개선

- 토큰당 비용 약 15% 절감