핵심 요약

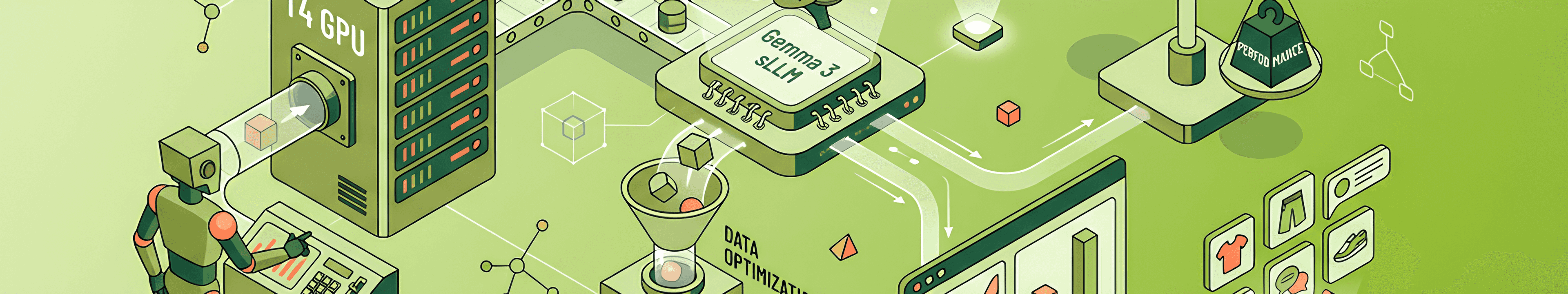

AWS가 SageMaker AI에서 GPT-OSS 120B를 활용한 추론 성능 테스트와 GPU 용량 산정을 다루는 블로그를 공개했습니다. 프리필/디코드와 KV 캐시, 연속 배치, 페이지드 어텐션 등 최적화 기법과 vLLM 및 SGLang 벤치를 비교해 실무 인프라 설계에 필요한 인사이트를 제공합니다.

구현 방법

- SageMaker AI에서 vLLM과 SGLang 가상환경 구성 및 설치

- 텐서 병렬 8, max-model-len 4096, gpu-memory-utilization 0.8 설정

- 200프롬프트 벤치로 엔드포인트 구동 및 성능 수치 확인

주요 결과

- 총 200프롬프트 성공, 입력 토큰 409,318개, 출력 토큰 TPS 259.92

- 평균 TTFT 924.48 ms, P99 TTFT 5223.02 ms, 총 토큰 처리량 1979.11 tok/s

- 피크 동시성 17건으로 벤치의 처리량 한계 파악